Z-Image

Motor de generación de imágenes ligero

Z-Image es una herramienta ligera de generación de imágenes con una eficiente arquitectura de inferencia de 8 pasos. Ofrece generación de imágenes IA rápida y de alta calidad en GPUs de consumo mientras reduce significativamente los costos computacionales.

Dimensions

Galería de Ejemplos

Saxofonista de Jazz Cinematográfico

Documental Callejero Tokio Noche Lluviosa

El Artesano Relojero

Retrato Hanfu Dinastía Tang

Textura de Alta Moda

Ilustración Studio Ghibli

Póster de Película Vintage "El Sabor del Recuerdo"

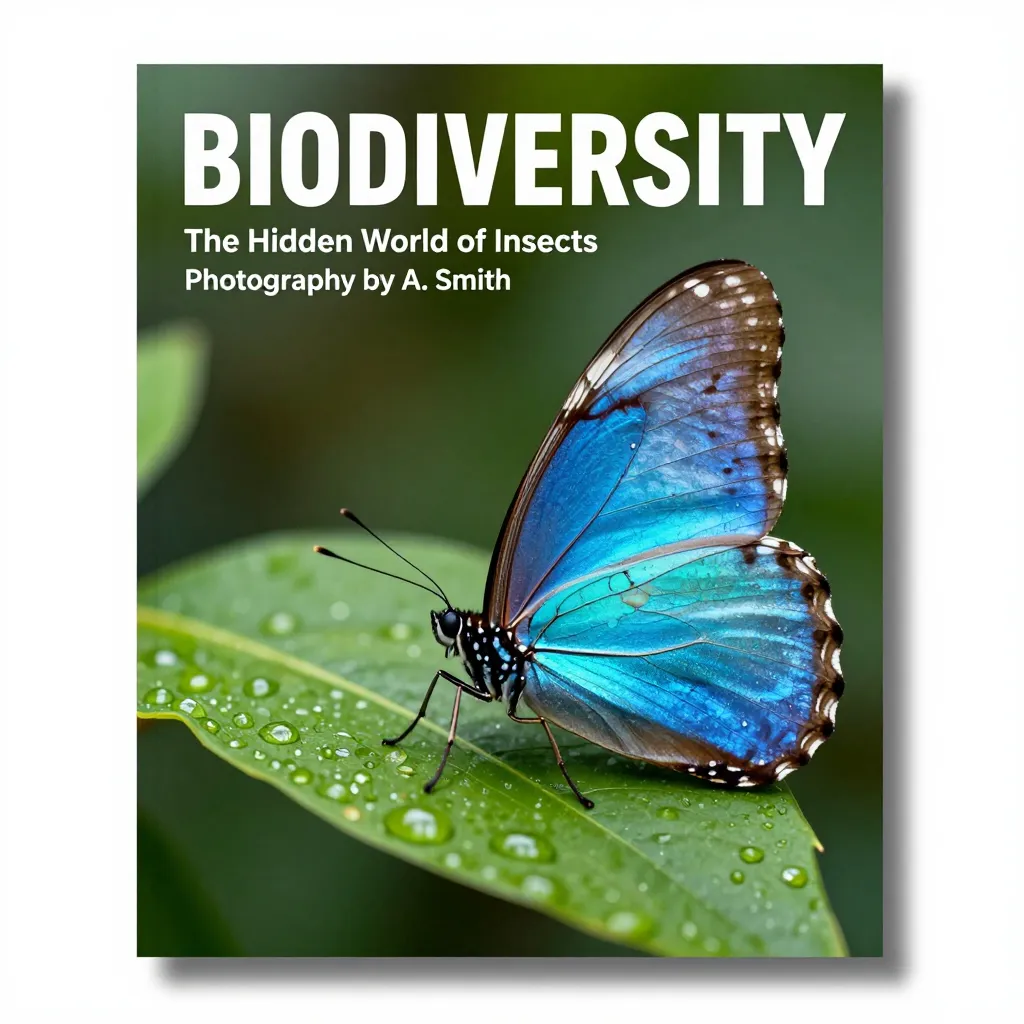

Portada de Revista Nature

Diseño de Póster de Silla Minimalista

No solo rápido, es Totalmente Evolucionado

Llenando el vacío entre modelos ligeros y masivos, Z-Image-Turbo encuentra el equilibrio perfecto entre velocidad, calidad y usabilidad.

Soporte Bilingüe Nativo

Impulsado por Qwen 3.4B LLM. No más caracteres chinos ilegibles. La caligrafía, la señalización y la tipografía compleja se renderizan con precisión.

Flujo Único S3-DiT

Innovación arquitectónica radical. Los tokens de texto e imagen se procesan de manera consistente, similar a GPT-4, utilizando cada parámetro tanto para generación como para comprensión.

Licencia Apache 2.0

Verdadera libertad de código abierto. A diferencia de las restricciones comerciales de Flux.1, eres libre de usarlo comercialmente, modificarlo e integrarlo. Ideal para startups.

S3-DiT: Rompiendo Barreras Modales

Los modelos tradicionales usan arquitectura de "doble flujo". Z-Image-Turbo adopta Transformer de Difusión de Flujo Único Escalable (S3-DiT).

- Flujo de Entrada Unificado: Tokens de texto y latentes de imagen se concatenan directamente.

- Interacción Total de Parámetros: Cada capa Transformer realiza un cálculo profundo de atención texto-imagen.

- Decoupled-DMD: El algoritmo central que comprime la inferencia a solo 8 pasos.

- Mejora CFG: Señales de guía optimizadas independientemente para imágenes nítidas sin valores CFG altos.

¿Por qué elegir Z-Image-Turbo?

Proporcionamos la solución óptima equilibrando rendimiento, costo y ecosistema.

| Métrica | Z-Image-Turbo | Flux.1 (Dev) | SDXL Base |

|---|---|---|---|

| Parámetros | 6B (Equilibrado) | 12B (Masivo) | 2.6B |

| Req VRAM | 12GB (Nativo BF16) | 24GB+ (o Quant) | 8GB |

| Pasos | 8 Pasos (Destilado) | 20-50 Pasos | 20-50 Pasos |

| Codificador Texto | Qwen 3.4B (Bilingüe) | T5 + CLIP | OpenCLIP |

| Tipografía | ⭐️⭐️⭐️⭐️⭐️ Perfecto | ⭐️⭐️ Pobre | ⭐️ Ilegible |

| Licencia | Apache 2.0 | No Comercial | OpenRAIL++ |

| Costo/Img | ~$0.0029 | Alto | Bajo |

Una bendición para hardware de consumo

Gracias a la escala de 6B parámetros y la destilación de 8 pasos, Z-Image-Turbo logra generación en 2-3s en RTX 3090/4090. Para H800 empresariales, la respuesta sub-segundo es realidad.

Inicio Rápido

# Carga rápida con Diffusers

from diffusers import DiffusionPipeline

import torch

# Cargar modelo Turbo 8 pasos

pipe = DiffusionPipeline.from_pretrained(

"Tongyi-MAI/Z-Image-Turbo",

torch_dtype=torch.bfloat16

).to("cuda")

# Generar imagen

image = pipe(

prompt="Detective cyberpunk, noche lluviosa, luces de neón, cartel chino que dice "Laboratorio Tongyi"",

num_inference_steps=8,

guidance_scale=1.0 # Modelos destilados no necesitan alto CFG

).images[0]

Preguntas Frecuentes

Preguntas sobre despliegue, uso y licencias.

¿Requisitos de GPU?

Para precisión nativa (BF16), se recomienda 16GB VRAM (RTX 4080/3090). Con cuantización GGUF/NF4, tarjetas de 8GB VRAM (RTX 3060) funcionan fluidamente con pérdida de calidad mínima.

¿Puedo usarlo comercialmente?

Sí. Z-Image-Turbo usa la licencia permisiva Apache 2.0. Puedes usarlo libremente para productos comerciales sin tarifas.

¿Cómo escribir prompts chinos?

Como chatear naturalmente. Gracias a Qwen 3.4B, puedes usar oraciones complejas. Para renderizar texto, pon el texto específico entre comillas.

¿Soporte para ComfyUI / WebUI?

Sí. ComfyUI tiene soporte desde el día 0. El soporte para Automatic1111 WebUI está en la rama dev y llegará pronto.

¿Ventaja sobre Flux.1?

Z-Image-Turbo resuelve eficiencia y usabilidad. Mientras Flux es genial para calidad extrema, Z-Image ofrece 3x velocidad, mitad de uso VRAM y soporte chino superior.